Inhaltsverzeichnis

🚦 Die Illusion der Kontrolle: Warum grüne Dashboards exakt gar nichts ausliefern

Nichts beruhigt die Vorstandsangst so zuverlässig wie ein lückenlos zugekleisterter Kalender. Ein Blick auf das Portfolio-Dashboard einer typischen Organisation reicht und die Auslastungsmetriken leuchten tiefgrün. Entwickler*innen sind über drei parallele Projekte hinweg doppelt gebucht. Product Owner jonglieren zeitgleich mit fünf strategischen Priorität-1-Initiativen. Das mittlere Management verbringt den kompletten Tag in endlosen Alignment-Calls, nur um die roten Ampeln der operativen Ebene irgendwie wegzumoderieren. Alle arbeiten an der absoluten Kapazitätsgrenze. Nach klassischer BWL-Logik müsste diese Organisation eine unaufhaltsame Maschine der Wertschöpfung sein.

Ist sie aber nicht. Ein Blick auf den tatsächlichen Output zeigt: Die Delivery-Pipeline ist ein extrem hochbezahlter Parkplatz. Story-Tickets verrotten über Quartale hinweg in Jira. Die Time-to-Market ist faktisch so tot wie ein Nokia-Strategiepapier.

Wenn die Pipeline verstopft, ist der Reflex in der Teppichetage hochgradig vorhersehbar. Man gerät in Panik, fordert lauthals “Effizienz” und drückt noch eine weitere strategische Priorität in den ohnehin blockierten Trichter, um die verlorene Zeit aufzuholen. Genau in diesem Moment zieht das Unternehmen seinen eigenen Beatmungsschlauch. Wir managen die Komplexität der 2020er Jahre allen Ernstes noch mit dem Taylorismus der 1920er. Ein stillstehendes Fließband verbrennt Geld, also darf das Band niemals anhalten. Kognitive Kapazität auf 100 Prozent Auslastung zu optimieren, ist keine Führung. Es ist organisatorische Sabotage.

🥶 Corporate Thrashing: Wenn das Betriebssystem kollabiert

Um zu verstehen, was mit einer Organisation unter Volllast passiert, müssen wir uns ein Konzept aus der Informatik borgen: Thrashing. Wenn der Arbeitsspeicher eines Computers voll ist, beginnt das Betriebssystem, Daten auf die Festplatte auszulagern. Erhöht man die Last weiter, erreicht das System einen physikalischen Kipppunkt. Die CPU verbringt plötzlich 100 Prozent ihrer Rechenleistung nur noch damit, Daten hin und her zu schaufeln. Sie verbringt exakt null Prozent damit, tatsächliche Programme auszuführen. Die Maschine friert ein. Das System überhitzt. Bei maximaler Auslastung. Der Durchsatz fällt auf null. Der Autor Seth Godin hat genau dieses Phänomen präzise auf die Arbeitswelt übertragen und den Begriff des “Corporate Thrashing” geprägt. Es ist exakt das, was passiert, wenn ein Management-Team zu viele strategische Initiativen parallel zündet.

Im modernen Büro ist das “Datenschaufeln” ein extrem hochbezahlter Zuschauersport. Er besteht aus crossfunktionalen Alignment-Calls, endlosen Status-Syncs und dem absoluten Heiligen Gral der Unternehmensparalyse: dem Steering Committee. Wenn jede Abteilung über fünf parallele Top-Prioritäten hinweg auf 100 Prozent Kapazität läuft, mutiert jede noch so kleine Anfrage zu einer blockierenden Abhängigkeit. Weil die Kalender aller Beteiligten bis Weihnachten restlos dicht sind, hat niemand auch nur zehn Minuten Zeit, um einen simplen Pull Request zu reviewen. Das Ergebnis ist auf tragische Weise komisch. Du bezahlst Senior-Entwickler*innen 80.000 Euro im Jahr, damit sie dreißig Stunden pro Woche in Meetings sitzen und anhand wunderschön farbcodierter Slide-Decks exakt erklären, warum sie leider keine einzige Zeile Code schreiben können. Die kognitive CPU der Organisation wird vollständig von der Meta-Arbeit aufgefressen, den eigenen Stillstand zu verwalten.

Herzlichen Glückwunsch. Du hast erfolgreich eine unfassbar teure Maschine gebaut, deren einziger operativer Output darin besteht, die eigene “Check Engine”-Leuchte am Brennen zu halten.

Wenn diese Maschine dann unweigerlich einfriert, ist der Standardreflex in der Teppichetage ein Meisterwerk der kontraproduktiven Logik. Das Management blickt auf die verstopfte Delivery-Pipeline und schlussfolgert messerscharf, dass die Teams schlichtweg nicht hart genug arbeiten. Das vorgeschlagene Heilmittel? Noch mehr Last. Man verlangt tägliche Statusberichte, um die Ineffizienz zu tracken, gründet eine neue “agile Taskforce” zur Überwachung des Stillstands und presst noch eine weitere Priorität-1-Initiative in den Trichter, um die verlorene Zeit irgendwie aufzuholen. Wenn ein Betriebssystem in der Informatik thrasht, garantiert das Einspeisen von noch mehr Daten einen fatalen Systemabsturz. In der Corporate-Welt wirst du für exakt dasselbe Vorgehen normalerweise zum Vice President of Operations.

📐 Die Physik des Stillstands: Warum Little’s Law immer gewinnt

Schauen wir uns den fundamentalen mathematischen Konstruktionsfehler in der Management-Logik an. Die Teppichetage liebt es, Wissensarbeit wie eine physische Produktionsanlage zu steuern. In einer tayloristischen Fabrikhalle der 1920er Jahre, in der identische Stahlzahnräder gestanzt werden, ist die Bearbeitungszeit perfekt vorhersehbar. Deshalb kann man das Fließband dort völlig gefahrlos bis kurz vor die Maximalkapazität hochdrehen, ohne das System zu sprengen. Aber moderne Produktentwicklung ist nun mal kein industrielles Fließband. Jedes einzelne Feature ist ein Prototyp, der in exakt dieser Form noch nie zuvor gebaut wurde. Die inhärente Komplexität ist massiv variabel.

Bevor wir den exponentiellen Abgrund der Wartezeiten erreichen, muss das Management der fundamentalen Gleichung ins Auge sehen, die es so hartnäckig ignoriert: Little’s Law. In John Littles originaler Operations-Research-Notation von 1961 lautet sie L = λ × W, und die Warteschlangentheorie diktiert hier eine unbarmherzige Realität. Im Original steht L für die Länge (Length) der Warteschlange (also die durchschnittliche Anzahl der Aufgaben im System), λ (Lambda) für die durchschnittliche Ankunftsrate und W für die Wartezeit (Wait time).

Die agile Welt dreht die Buchstaben gerne um, damit die Abkürzungen exakt passen: W steht dann für Work in Progress (WIP), λ für Durchsatz und L für Lead Time, was zur agilen Formel W = λ × L führt. Will man berechnen, wie lange ein Feature tatsächlich bis zur Auslieferung braucht – exakt das, was das Management ständig fragt –, stellt man diese Formel ganz simpel um zu L = W / λ (also Lead Time = WIP / Durchsatz). Die physikalischen Gesetze dahinter sind schlichtweg nicht verhandelbar. Wir sprechen hier von einer mathematischen Gewissheit, nicht von der netten philosophischen Empfehlung von Junior-Scrum-Mastern.

Little’s Law: Mehr Arbeit in einem vollen System erhöht lediglich die Wartezeit

Übertrage das mal auf die Realität eines typischen europäischen Strategie-Offsites. Wenn das Management aggressiv neue “Priorität 1”-Initiativen in den Trichter (λ) drückt, während die Teams bereits unter Volllast laufen, explodiert der Work in Progress (W). Weil die Gleichung zwingend im Gleichgewicht bleiben muss, muss sich die Lead Time (L) physikalisch in die Länge ziehen. Noch mehr parallele Projekte in eine ohnehin verstopfte Pipeline zu kippen, erhöht den Durchsatz nicht auf magische Weise. Es erzwingt mathematisch, dass jedes einzelne Projekt proportional länger bis zur Fertigstellung braucht. Du beschleunigst damit keine Delivery. Du maximierst lediglich die Zeit, in der dein hartes Kapital nutzlos in unfertigem Inventar gebunden ist.

📉 Der exponentielle Abgrund: Die Kingman-Formel und der menschliche Prozessor

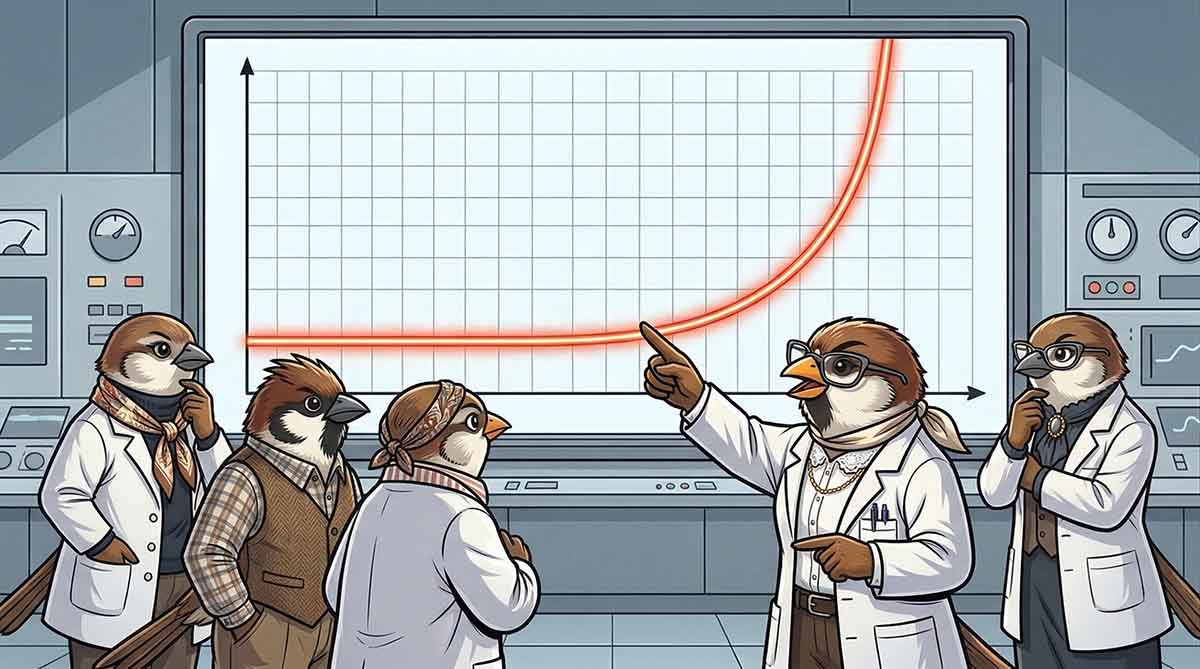

Vorhang auf für Sir John Kingman und die unbarmherzige Mathematik der Warteschlangentheorie. Die Kingman-Formel beweist schwarz auf weiß: In jedem System mit variablen Bearbeitungszeiten ist die Beziehung zwischen Auslastung und Wartezeit kein sanfter Anstieg, sondern ein massiver exponentieller Abgrund. Wenn ein Team zu 50 Prozent ausgelastet ist, liegt die Wartezeit für eine neue Anforderung praktisch bei null. Bei 80 Prozent beginnt sich die Warteschlange langsam aufzubauen. Aber in dem Moment, in dem das Management die Peitsche knallen lässt und die Auslastung in Richtung der heiß begehrten 100-Prozent-Marke presst, steigt die Wartezeit nicht einfach nur linear an. Sie schießt komplett vertikal in die Höhe. Sie nähert sich unweigerlich der Unendlichkeit.

Kingman-Kurve: Optimierung auf 100% Auslastung garantiert exakt 0% Delivery

In dem verzweifelten Versuch sicherzustellen, dass kein hochbezahltes Teammitglied jemals auch nur eine einzige Sekunde Leerlauf hat, erzwingt das Management rein mathematisch, dass jede strategische Initiative 90 Prozent ihres Lebenszyklus damit verbringt, in einer “Waiting for Review”-Spalte zu verrotten.

Du hast keine Hochleistungs-Delivery-Engine gebaut, sondern ein hocheffizientes Museum für alternden Code konstruiert.

Aufmerksame Beobachtende könnten hier nun ein Paradoxon wittern: “Moment, hast du uns nicht gerade noch dafür kritisiert, dass wir Menschen wie Maschinen behandeln? Und jetzt nutzt du CPU-Architektur und Server-Warteschlangentheorie, um dein Argument zu stützen?” Ja, exakt das tue ich. Ich nutze die harte Mathematik von Maschinen aus einem extrem simplen Grund: Menschen sind unfassbar viel schlechter darin, eine Maschine zu sein, als tatsächliche Maschinen. Ein Siliziumprozessor hat exakt null Emotionen, benötigt keine psychologische Sicherheit und brennt niemals aus. Gut, es sei denn, du hast Amazons New World gespielt und die ungedeckelte Framerate hat deine Grafikkarte buchstäblich in einen teuren Briefbeschwerer verwandelt.

Die Rüstzeit eines Kontextwechsels wird bei einer CPU in Nanosekunden gemessen. Laut kognitiver Arbeitspsychologie betragen die Rüstkosten für exakt denselben Kontextwechsel bei menschlichen Entwickler*innen stolze 23 Minuten und 15 Sekunden. Das ist fast eine halbe Stunde, in der sie auf den Bildschirm starren und verzweifelt versuchen, ihr mentales Modell wieder aufzubauen, garniert mit der wachsenden existenziellen Angst vor der nahenden Deadline. Wenn es rein mathematisch einen fatalen Systemabsturz garantiert, ein völlig gefühlloses Stück Metall auf 100 Prozent Kapazität zu treiben, was glaubst du, macht exakt dieselbe Management-Philosophie wohl mit einem biologischen Gehirn? Die physikalischen Gesetze gelten nicht einfach nur für deine Mitarbeiter*innen. Sie schlagen zehnmal härter ein. Und zerquetschen sie.

Wenn einem Linux-Server durch massives Thrashing der Arbeitsspeicher ausgeht, killt der systemeigene OOM-Prozess (Out of Memory) gnadenlos Tasks, um die restliche Maschine am Leben zu halten. Wenn einem biologischen Menschen das kognitive RAM ausgeht, greift sein interner OOM-Killer exakt genauso unbarmherzig ein, um den Wirt zu schützen. Er schießt schlichtweg die Motivation ab. Das Resultat: Dienst nach Vorschrift, “Quiet Quitting” oder ein sehr plötzliches, von ärztlicher Seite verordnetes Sabbatical.

🐢 Der Realitätsabgleich: Der dreimonatige “Quick Fix”

Wenn du live dabei zusehen willst, wie Kingmans exponentielle Kurve eine Timeline in freier Wildbahn zerlegt, beobachte einfach den majestätischen Lebenszyklus eines trivialen Jira-Tickets. Die Aufgabe ist geradezu unverschämt simpel: ein kleines Update an einem Payment-API-Endpoint. Tom zieht das Item an einem Montagmorgen. Um 11:00 Uhr ist der Code geschrieben und die lokalen Tests leuchten grün. Eine makellose Demonstration moderner Softwareentwicklung. Das Ticket wandert erwartungsgemäß in die Spalte “Waiting for Code Review”, noch in seliger Unwissenheit über die bürokratische Hölle, in die es gleich hinabsteigen wird.

In einem gesunden System mit kognitivem Slack zieht sich ein*e Kolleg*in nach der Mittagspause den Pull Request, macht das Code-Review und das Ding geht noch am selben Tag live. Aber diese Organisation optimiert nun mal auf 100 Prozent Auslastung. Sarah, die zwingend erforderliche Reviewerin, ist in crossfunktionalen Alignment-Meetings doppelt gebucht und hämmert parallel panisch ihr eigenes “Priorität 1”-Feature in die Tastatur. Weil ihr Kalender ein massiver Tetris-Block ist (kurz bevor der rettende lange Stein fällt), versauert das triviale Update acht volle Tage lang völlig unberührt in der Review-Spalte.

Als Sarah endlich eine mikroskopisch kleine Lücke zwischen zwei Meetings findet, um den Code zu checken, hinterlässt sie einen einzigen, völlig berechtigten Kommentar zu einer Namenskonvention. Der Pull Request fliegt zurück über den Zaun. Tom braucht exakt fünf Minuten, um die Variable anzupassen. Aber da Sarah mittlerweile längst wieder metertief in einem völlig anderen Kontext vergraben ist, wandert das korrigierte Ticket direkt ans hinterste Ende ihrer Review-Warteschlange. Weitere fünf Tage vergehen.

Nachdem der Code endlich freigegeben ist, wandert er weiter nach “Waiting for QA”. Aber die zentralisierte Testing-Abteilung läuft ebenfalls auf maximaler Auslastung und ertrinkt gerade in den manuellen Regressionstests eines Legacy-Systems. Das triviale API-Update verrottet drei volle Wochen in ihrem Backlog. Als es endlich die QA-Hürde nimmt und bereit für die Produktion ist, reißt ein völlig anderes Team von heillos überlasteten Entwickler*innen versehentlich die gemeinsame Deployment-Pipeline ein. Das tatsächliche Release verzögert sich um weitere zwei Wochen.

Neunzig Tage, nachdem Tom die allerletzte Zeile Code in die Tastatur gehämmert hat, geht das triviale Update endlich in Produktion. Die tatsächliche Arbeitszeit betrug lächerliche zwei Stunden und zehn Minuten. Die Lead Time über das gesamte System hinweg lag bei drei vollen Monaten.

Wenn du das hier liest und dir denkst: “Das ist eine absurde Übertreibung, so etwas passiert in der Realität niemals”, herzlichen Glückwunsch. Entweder arbeitest du in einem kleinen Startup mit einer Handvoll Leuten, oder du hast schlichtweg noch nie einen ehrlichen Blick auf deine tatsächlichen Metriken geworfen. Bitte die Person, die über die Metriken herrscht, die echte Lead Time eurer niedrigstpriorisierten Tickets aus der Datenbank zu ziehen. In einer skalierten Corporate-Matrix ist das absolut kein Edge Case. Es ist Standard Operating Procedure. Keine einzige dieser Verzögerungen entstand durch böse Absicht, Faulheit oder Inkompetenz. Jeder einzelne Flaschenhals war eine vollkommen rationale, lokal optimierte Entscheidung eines biologisch massiv überforderten Menschen, der lediglich versucht hat, einen zu 100 Prozent vollgestopften Kalender zu überleben.

🧠 Die Grauzone: Die kognitiven Rüstkosten der “Dauerbeschäftigung”

Was genau passiert eigentlich, während Toms triviales API-Update acht volle Tage lang in der Review-Warteschlange versauert? Tom starrt in dieser Zeit natürlich nicht auf einen leeren Bildschirm. Die Excel-Tabellen der Teppichetage fordern schließlich lückenlose Aktivität. Um also brav zu 100 Prozent ausgelastet zu bleiben, zieht Tom das nächste Ticket aus dem Backlog. Wenn dieses zweite Ticket dann unweigerlich an der nächsten Abhängigkeit zerschellt, zieht er sich direkt ein drittes. Auf dem Management-Dashboard leuchtet Tom jetzt als hochperformantes Asset auf, das drei kritische Aufgaben gleichzeitig jongliert. Für kognitive Arbeitspsychologen ist Tom hingegen das absolute Paradebeispiel eines systemischen biologischen Totalausfalls.

Exakt diese Dynamik verwandelt dein Daily Standup in ein tägliches Geiselvideo. Fünf völlig erschöpfte Entwickler*innen starren mit leeren Augen in ihre Webcams und murmeln mechanisch “Keine Blocker, weiterhin in Progress” in ihre Mikrofone, während das Sprint Board hinter ihnen lichterloh abfackelt.

Biologisches Thrashing: Das Gehirn ist kein Multi-Core-Prozessor. Jeder erzwungene Kontextwechsel verbrennt massiv produktive Zeit rein für Rüstkosten und hinterlässt blockierende Aufmerksamkeitsrückstände.

Tom ist nun mal kein Multi-Core-Prozessor. Wenn er dieses zweite Jira-Ticket öffnet, drückt sein Gehirn nicht einfach sauber die Pausetaste für das erste. Es muss rein physikalisch ein hochkomplexes mentales Modell aus dem Arbeitsspeicher werfen und ein völlig neues laden. Die American Psychological Association hat diese exakte Reibung gemessen: Dieses permanente Kontextwechsel-Pingpong verbrennt schlagartig bis zu 40 Prozent der produktiven Arbeitszeit. Und der wahre Kollateralschaden ist noch viel schlimmer. Man kann ein ungelöstes Problem nicht einfach sauber pausieren. Es hinterlässt das, was die Forschung “Attention Residue” nennt. Ein beträchtlicher Teil von Toms mentalem RAM bleibt permanent an das blockierte API-Update gebunden. Er versucht jetzt verzweifelt, Code für Ticket B zu schreiben, während sein Gehirn unterbewusst immer noch hartnäckig an Ticket A klebt.

Fünf Tage später hinterlässt Sarah dann endlich ihren einzigen Kommentar im ursprünglichen Pull Request. Eine Slack-Notification ploppt auf. Tom lässt Ticket C sofort fallen, um die Variable in Ticket A zu fixen. Die Forscherin Gloria Mark von der UC Irvine hat exakt gemessen, was danach passiert: Nach einer solchen Unterbrechung dauert es im Durchschnitt 23 Minuten und 15 Sekunden, nur um den ursprünglichen Zustand des tiefen Fokus wiederherzustellen. Multipliziere dieses permanente kognitive Schleudertrauma jetzt mal mit einer fünfzigköpfigen Entwicklungsabteilung, die hart am Kapazitätslimit operiert. Du bezahlst hier schon lange nicht mehr für Softwareentwicklung. Du zahlst absolute Top-Gehälter für biologisches Thrashing.

🛡️ Die Verteidigung: Wie man Slack an die Excel-Tabelle verkauft

Wenn die Physik von Slack so unbestreitbar ist, warum verfällt dann jede Organisation ganz natürlich wieder in den 100-Prozent-Auslastungs-Wahn? Weil ein randvoller Kalender für eine Excel-Tabelle nun mal effizient aussieht. Wenn eine Führungskraft an einer Reihe von Schreibtischen vorbeigeht (oder eine Reihe von grünen Teams-Statuspunkten scannt), sieht sie weder Zykluszeiten noch Flusseffizienz. Sie sieht vielbeschäftigte Menschen, die schnell tippen. Sie sieht Aktivität. Und in der Corporate-Welt ist sichtbare Aktivität die primäre Metrik für Kontrolle. Es ist schlichtweg viel einfacher, den Schweiß auf der Stirn eines Teammitglieds zu managen als die tatsächliche Geschwindigkeit eines ausgelieferten Features.

Genau deshalb fühlt sich die Bitte an die Chefetage um “20% Slack-Time” karrieretechnisch wie ein garantiertes Selbstmordkommando an. Wenn ein Agile Coach um etwas Luft zum Atmen bittet, hört das Business nur die Forderung nach bezahltem Urlaub. Sie hören Entwickler*innen, die lieber mit glänzenden neuen Frameworks herumspielen wollen, anstatt echten Mehrwert für den Kunden auszuliefern. Für die Excel-Tabelle übersetzt sich das Wort “Slack” direkt mit “Verschwendung”.

Wenn du diese Dynamik ändern willst, musst du aufhören, das Wort “Slack” zu verwenden. Ein pragmatischer Director will keine agile Philosophie finanzieren; er will die Margen des Unternehmens schützen. Du musst die Physik also in ihre Sprache übersetzen. Wenn die Führungsetage mehr Output fordert, bittest du nicht um Luft zum Atmen. Du ziehst die echten Daten für Toms triviales API-Update heran und präsentierst einen simplen Business Case: “Wollen wir, dass dieses Feature unser Kapital bindet und die Pipeline für drei Monate blockiert, oder soll es in drei Tagen live gehen?” Du musst die gesamte Konversation weg von der individuellen Auslastung lenken. Du verteidigst nicht länger den Kalender der Entwickler*innen, sondern die Lieferfähigkeit des Unternehmens.

🛑 Das Gegenmittel: Die politische Gefahr der ungenutzten Zeit

Schaffen wir nun in exakt derselben Organisation einfach mal 20 Prozent Slack. Sarah hat immer noch Meetings, aber in ihrem Kalender gibt es jetzt Luft zum Atmen. Wenn Tom mit dem Code fertig ist, wirft er den Pull Request nicht einfach über den Zaun in ein schwarzes Loch. Er bittet Sarah ganz simpel um ein kurzes Review. Da sie nicht in konkurrierenden “Priorität 1”-Bränden ertrinkt, hat sie tatsächlich 15 Minuten Zeit. Die beiden machen einen kurzen Call oder setzen sich zusammen. Sarah entdeckt das Problem mit der Namenskonvention und Tom fixt es live. Das Review dauert exakt zehn Minuten hochbandbreitige, synchrone Zusammenarbeit.

Das Ticket wandert weiter in die QA. Weil die Testing-Abteilung ebenfalls mit einem Puffer von 20 Prozent operiert, gibt es dort keinen dreiwöchigen Backlog. Ein*e Tester*in zieht sich das API-Update noch am selben Nachmittag. Und diese fragile, gemeinsame Deployment-Pipeline? Sie bricht nicht zusammen. Das andere Entwicklerteam musste nämlich kein Release panisch durchpeitschen, was bedeutet: Sie hatten den Slack, um schon vor Wochen vernünftige, automatisierte Leitplanken aufzubauen.

Die Zwei-Stunden-Aufgabe ist direkt am nächsten Morgen in Produktion. Gleicher Code. Gleiche Leute. Der einzige Unterschied ist der bewusst geschaffene, mathematische Raum, der es einem System überhaupt erst ermöglicht, zu funktionieren.

Das Heilmittel für dieses mathematische Desaster ist wissenschaftlich trivial, aber politisch furchteinflößend. Du musst Slack einführen. Die zeitliche Dimension. Nicht das SaaS-Produkt, das dich gerade mit einer neuen Abhängigkeit anpingt.

Wie der Ingenieur Donald Reinertsen für die Produktentwicklung mathematisch bewiesen hat, musst du die organisatorische Auslastung bewusst auf maximal 80 Prozent senken, ohne vorzuschreiben, was mit der Leerlaufzeit geschehen soll. Für eine traditionelle Führungskraft, die ihr Handwerk damit gelernt hat, den Output einer Fabrik zu maximieren, klingt es nach einem fristlosen Kündigungsgrund, 20 Prozent einer hochbezahlten Entwicklerschaft bewusst “im Leerlauf” zu belassen. In einer Excel-Tabelle sieht das aus wie Faulheit.

Aber diese 20 Prozent sind keine verschwendete Zeit, in der Entwickler*innen heimlich YouTube schauen. Es ist der kognitive Stoßdämpfer für die Realität. Ohne ihn wird jeder einzelne Bug in Produktion, jeder Krankheitstag oder jedes vage formulierte Jira-Ticket sofort zu einem abteilungsübergreifenden Verkehrsstau. Du kannst entweder für Slack bezahlen, oder du bezahlst für permanenten Stillstand. Die Gesetze der Physik diktieren, dass man nicht beides vermeiden kann.

Du kannst dich nicht auf die Selbstbeherrschung der Führungsetage verlassen, um diesen 20-Prozent-Puffer aufrechtzuerhalten. In dem Moment, in dem die Abteilungsleitung eine*n Entwickler*in mit einem freien Nachmittag sieht, wird sie instinktiv versuchen, diesen mit einer neuen strategischen Initiative zu füllen. Den Nachmittag. Nicht die Person. Der einzige Weg, deinen kognitiven Stoßdämpfer zu schützen, ist eine harte, strukturelle Einschränkung: die strikte Begrenzung von Work In Progress (WIP).

Pionierarbeit in der Softwareentwicklung leisteten hierbei David J. Anderson und die Kanban-Methode: Ein WIP-Limit ist eine absolute Obergrenze für die Anzahl der aktiven Aufgaben, die ein Team, eine ganze Abteilung oder sogar eine komplette Organisation gleichzeitig bearbeiten darf. Wenn das Limit erreicht ist, riegelt das System mathematisch ab. Es kommen keine neuen “Priorität 1”-Tickets mehr in die Pipeline, bis ein bestehendes Item vollständig abgeschlossen, deployed und vom Tisch ist. Es zwingt die Organisation dazu, endlich aufzuhören anzufangen, und stattdessen anzufangen abzuschließen.

Wenn ein WIP-Limit das Board mathematisch abriegelt, sind Entwickler*innen, die ihre Aufgabe beendet haben, strukturell davon abgehalten, sich ein neues Jira-Ticket zu ziehen. Beim klassischen Management löst das eine Urangst aus: ein untätiges Teammitglied. Aber genau hier entfaltet der 20-Prozent-Puffer seine Magie.

Anstatt blind neuen Code anzufangen, der sich unweigerlich vor der nächsten blockierten Spalte aufstauen wird, müssen diese Entwickler*innen über das Board schauen und fragen: “Wer braucht Hilfe, um ein bestehendes Item über die Ziellinie zu bringen?” Sie stürzen sich im Schwarm auf den Engpass. Sie führen Code-Reviews durch, schreiben notwendige Dokumentation oder nutzen Pair-Programming, um einen hartnäckigen Bug zu beheben. Ein striktes WIP-Limit erzwingt fundamental Zusammenarbeit statt individueller Geschäftigkeit. Es zwingt eine Organisation dazu, aufzuhören, ihre Entwickler*innen wie isolierte Fabrikmaschinen zu behandeln, und stattdessen das System auf das zu optimieren, was wirklich zählt: Durchsatz.

📊 Flusseffizienz: Hört auf, Schweiß zu tracken, fangt an, Geschwindigkeit zu messen

Solange eure Executive-Dashboards rund um Ressourcenallokation aufgebaut sind, wird sich absolut nichts ändern. In europäischen Unternehmen setzen Betriebsräte zu Recht strenge Grenzen dafür, wie individuelle Tracking-Daten genutzt werden dürfen. Der Stoppuhr beraubt, zieht sich das Management stattdessen darauf zurück, abstrakte Geschäftigkeit zu messen: volle Projektzuweisungen, gebuchte Personentage und perfekt verteilte FTEs. Um eure Liefergeschwindigkeit zu schützen, müsst ihr die Metrik komplett auf den Kopf stellen. Ihr müsst aufhören zu messen, ob eure Entwickler*innen zu 100 Prozent einem Projekt zugewiesen sind, und anfangen zu messen, wie viel Zeit ein Projekt auf eine*n Entwickler*in wartet.

Die Metrik, nach der ihr sucht, nennt sich Flusseffizienz (Flow Efficiency). Die Berechnung ist brutal simpel: Teile die aktive Arbeitszeit durch die gesamte Durchlaufzeit (Lead Time). Denk noch einmal an Toms API-Update zurück: Zwei Stunden tatsächliche Arbeit, ertränkt in neunzig Tagen Wartezeit. Wenn man das durchrechnet, hatte dieses spezifische Feature eine Flusseffizienz von deutlich unter einem Prozent. Für über 99 Prozent seines Lebenszyklus wurde nicht an eurem investierten Kapital gearbeitet. Es saß einfach nur in einer Jira-Spalte, verrottete in einer Warteschlange und wartete auf einen zu 100 Prozent ausgelasteten Menschen, der endlich mal fünfzehn Minuten Zeit erübrigen konnte.

Das Flusseffizienz-Paradoxon: Das Management investiert massiv in die Mikromanagement-Optimierung der wenigen Stunden aktiver Arbeitszeit, ignoriert dabei aber völlig die Monate an teurer Wartezeit in den verstopften System-Warteschlangen.

Wenn Führungskräfte eine festgefahrene Pipeline sehen, ist ihr erster Instinkt, die einzelnen Entwickler*innen dazu zu bringen, schneller zu tippen. Sie kaufen teure KI-Coding-Assistenten in der Hoffnung, zehn Minuten bei einer zweistündigen Aufgabe einzusparen. Aber rein mathematisch betrachtet, ist die Optimierung dieses einen Prozents an aktiver Arbeit eine völlige Kapitalverschwendung, wenn man die 99 Prozent Wartezeit weiterhin ignoriert. Die Flusseffizienz zwingt die Chefetage dazu, sich auf das eigentliche finanzielle Leck zu konzentrieren: die Warteschlangen. Sobald man anfängt zu messen, wie lange die eigenen Investitionen ungenutzt zwischen überlasteten Abteilungen herumliegen, ist die Einführung strikter WIP-Limits kein radikales agiles Experiment mehr. Es wird zu einer grundlegenden treuhänderischen Pflicht.

Eine tiefgrüne Ressourcenmatrix, die an die Wand des Konferenzraums projiziert wird, ist kein Triumph des Managements. Es ist ein mathematisch garantierter Verkehrsstau. Wenn das PMO stolz eine Tabellenkalkulation präsentiert, in der alle Entwickler*innen zu exakt 100 Prozent ausgebucht sind, haben sie nicht eure Time-to-Market optimiert. Sie haben lediglich das Reporting erfolgreich optimiert. Der Lenkungsausschuss darf sich in völliger Kontrolle wähnen, in der komfortablen Ahnungslosigkeit, dass er gerade den am akribischsten dokumentierten Stillstand der gesamten Branche finanziert.

In dem Moment, in dem ihr die Ressourcenauslastung auf dem Management-Dashboard durch Flusseffizienz ersetzt, ändert sich die gesamte Diskussion im Unternehmen grundlegend. Abteilungsleiter hören auf zu fragen: “Wer hat noch freie Kapazitäten?” und fangen an zu fragen: “Warum wartet dieses Prioritäts-Ticket?” Ihr hört endlich auf zu versuchen, die einzelnen Entwickler*innen zu mikromanagen, und fangt an, das System zu managen. Das ist der einzige Weg, wie ihr euch eure Time-to-Market tatsächlich zurückkauft.

Hier ist ein Benchmark, um euer nächstes Management-Offsite zu ruinieren: Der Branchendurchschnitt für die Flusseffizienz in der Softwareentwicklung liegt bei etwa 15 Prozent. Laut Lean-Praktikern und Flow-Forschern operieren nicht-optimierte Enterprise-Teams häufig zwischen 1 und 5 Prozent. Wenn eure Abteilung es schafft, 40 Prozent zu erreichen, seid ihr nicht nur gut; ihr agiert auf einem elitären, erstklassigen Niveau.

Eine Flusseffizienz von 100 Prozent ist in der teambasierten Wissensarbeit praktisch unmöglich, da komplexes Engineering von Natur aus gewisse Wartezeiten erfordert – das Warten auf den Abschluss automatisierter Build-Pipelines, Deployments in Testumgebungen oder einfach nur die Koordination zweier Terminkalender für eine synchrone Pair-Programming-Session.

Und hier ist das ultimative Paradoxon: Wenn euer Dashboard anzeigt, dass eure Entwickler*innen zu 100 Prozent ausgelastet sind, garantiert die Kingman-Formel, dass eure Flusseffizienz bei 2 Prozent liegt. Ihr zahlt absolute Spitzengehälter dafür, dass die Leute völlig erschöpft sind, während die eigentliche Arbeit komplett stillsteht.

🏁 Fazit: Man kann die Physik nicht wegmanagen

Management in der Wissensarbeit ist kein Kampf gegen menschliche Faulheit. Es ist ein Kampf gegen die Physik von Systemen. Solange die Chefetage 100 Prozent Auslastung belohnt, finanziert sie aktiv ihren eigenen Stillstand. Sie zahlen Spitzengehälter, um Jira-Tickets beim Altern zuzusehen.

Die Wahl ist brutal einfach. Du kannst entweder voll ausgelastete Entwickler*innen haben, oder du kannst schnelle Release-Zyklen haben. Physikalisch gesehen kannst du nicht beides haben. Wenn du deine Time-to-Market beschleunigen willst, musst du akzeptieren, dass manchmal ein*e hochbezahlte*r Entwickler*in einfach nur aus dem Fenster starrt.

Es ist höchste Zeit, Frederick Winslow Taylor endgültig zu begraben und sein Fabrik-Handbuch aus den 1920er Jahren wegzuwerfen. Hört auf, ungenutzte Zeit zu bestrafen. Fangt an, aufgeblähten Work In Progress zu bestrafen. Hört auf zu versuchen, auch noch den letzten Tropfen kognitiver Kapazität aus euren Teams herauszuquetschen, und fangt an, den tatsächlichen Wertfluss zu managen.

Denn die Physik kümmert sich nicht um eure strategische Roadmap, eure Q3-Ziele oder eure Lenkungsausschüsse. Und Little’s Law hat noch nie einen Kampf verloren.

Übrigens gibt es eine gewaltige Variable, die wir bei dieser Gleichung bequemerweise weggelassen haben: den radioaktiven Zerfall der Arbeit selbst. Wenn Toms triviales API-Update wochenlang in einer Warteschlange liegt, wartet der Rest der Codebasis nicht geduldig ab. Er entwickelt sich weiter. Zu dem Zeitpunkt, an dem Sarah den Pull Request endlich freigibt, kann Tom nicht einfach auf “Merge” klicken. Er muss nun digitale Totenbeschwörung betreiben, um kaskadierende Merge-Konflikte aufzulösen, was einen Fünf-Minuten-Fix in einen weiteren Nachmittag hochriskanten technischen Leidens verwandelt. Dazu kommen die Verzögerungskosten (Cost of Delay) – der tatsächliche, entgangene Umsatz, aus dem das Unternehmen an jedem einzelnen Tag blutet, an dem ein fertiges Feature ungenutzt herumliegt. Aber der Zinseszins von Code-Verrottung und verzögerter Wertschöpfung bietet genug Material für einen völlig eigenen, separaten Deep-Dive.

⏱️ TL;DR: Der 30-Sekunden-Realitätsabgleich

Wenn du als Führungskraft zwischen Alignment-Meetings hin- und herrennst und nur dreißig Sekunden Zeit hast, um zu verstehen, warum deine Release-Zyklen kollabieren, lies das hier:

- 100 % Auslastung ist System-Sabotage: Deine Entwickler*innen auf einen perfekt ausgebuchten Kalender zu optimieren, garantiert mathematisch eine festgefahrene Delivery-Pipeline. Du maximierst die Zeit, in der dein Kapital in Warteschlangen festsitzt, nicht den tatsächlichen Output.

- Die Physik ist absolut: Die Kingman-Formel diktiert, dass ein voll ausgelastetes System keine variable Wissensarbeit absorbieren kann. Die Kapazität über 80 Prozent zu treiben, führt dazu, dass die Durchlaufzeiten exponentiell ins Unendliche wachsen. Man kann die Physik nicht wegmanagen.

- Kontextwechsel bedeuten finanzielles Ausbluten: Entwickler*innen dazu zu zwingen, mehrere blockierte “Priorität 1”-Tickets gleichzeitig zu jonglieren, zerstört bis zu 40 Prozent ihrer kognitiven Kapazität. Du zahlst absolute Spitzengehälter für biologisches Thrashing.

- Die Lösung ist kontraintuitiv: Du musst die Auslastung der Organisation absichtlich auf maximal 80 Prozent senken. Diese Slack-Time von 20 Prozent ist der kognitive Stoßdämpfer, der zwingend erforderlich ist, damit das System überhaupt im Fluss bleibt.

- Das Werkzeug sind WIP-Limits: Hör auf, individuelle Geschäftigkeit zu tracken, und fang an, die Flusseffizienz zu messen. Führe strikte Work-In-Progress-Limits (WIP) ein, um das System zu verriegeln und Teams zur Zusammenarbeit an Engpässen zu zwingen.

- Unterm Strich: Stop starting, start finishing.

🧾 Die Belege: Die Physik und die Daten

Die Physik verhandelt nicht mit dem Management. Wenn deine Geschäftsführung Beweise dafür verlangt, dass ihr Auslastungsfetisch das Unternehmen unweigerlich zum Stillstand bringen wird, leg diese Referenzen auf den Tisch:

- Corporate Thrashing: Um zu erklären, was mit einer Organisation unter maximaler Last passiert, zitiere Seth Godins Buch Linchpin aus dem Jahr 2010 (ISBN: 978-1591844099). Er übertrug das Informatik-Konzept des Arbeitsspeicher-Thrashings von Betriebssystemen ursprünglich auf das Verhalten von Organisationen und auf Projektüberlastung.

- Die Erfindung von Corporate Slack: Um den konzeptionellen Ursprung dafür nachzuverfolgen, warum es die Agilität zerstört, wenn man Wissensarbeiter auf 100 Prozent Kapazität treibt, zitiere Tom DeMarcos wegweisendes Buch Slack: Getting Past Burnout, Busywork, and the Myth of Total Efficiency aus dem Jahr 2001 (ISBN: 978-0767907699). Lange bevor moderne Skalierungs-Frameworks existierten, stellte DeMarco fest, dass Organisationen, die an ihrer maximalen Auslastungsgrenze operieren, jegliche Fähigkeit verlieren, auf Veränderungen zu reagieren, und damit effektiv ihre eigene Lähmung herbeiführen.

- Die Kosten von Kontextwechseln: Um zu beweisen, dass das Jonglieren mehrerer “Priorität 1”-Initiativen aktiv kognitive Kapazität zerstört, zitiere Gerald M. Weinbergs Klassiker Quality Software Management: Systems Thinking (ISBN: 978-0932633224). Er quantifizierte, dass die Zuweisung eines Senior-Entwicklers zu drei gleichzeitigen Projekten fast 50 Prozent seiner verfügbaren Zeit rein für die Meta-Arbeit des Kontextwechsels verbrennt.

- Die Mathematik des Stillstands: Um die Behauptung zu untermauern, dass eine Abteilung auf 100 Prozent Kapazität laufen zu lassen, die Delivery stoppt, verweise auf Donald G. Reinertsens The Principles of Product Development Flow (ISBN: 978-1935401001). Es ist das definitive Standardwerk für Ingenieure, das beweist, dass das Managen von Wissensarbeit ohne Kapazitätspuffer mathematisch massive Verzögerungen garantiert, und das die absolute Notwendigkeit etabliert, die Auslastung bei etwa 80 Prozent zu halten.

- Organizational Drag: Für empirische Daten zu dem 80.000-Euro-Zuschauersport “Meeting”, zitiere die Forschung von Michael Mankins und Eric Garton für Bain & Company, veröffentlicht in Time, Talent, Energy (ISBN: 978-1633691766). Sie berechneten, dass moderne Unternehmen massive Mengen ihrer gesamten produktiven Kraft an “Organizational Drag” verlieren: den endlosen Morast aus Alignment-Calls, Lenkungsausschüssen und Meta-Management.

- Die Mathematik unendlicher Wartezeiten: Um zu erklären, warum die Maximierung der Auslastung unweigerlich zu null Auslieferung führt, zitiere Sir John Kingmans grundlegendes Paper zur Warteschlangentheorie, “The single server queue in heavy traffic” (1961). Es enthält den mathematischen Beweis, dass Wartezeiten in variablen Umgebungen exponentiell ins Unendliche wachsen, wenn sich die Auslastung 100 Prozent nähert. Lies das Paper hier.

- Die 23-Minuten-Kontextwechsel-Strafe: Um die exakten kognitiven Kosten der Unterbrechung eines Entwicklers zu belegen, zitiere die grundlegende Studie von Gloria Mark, Daniela Gudith und Ulrich Klocke von der University of California, Irvine (2008): “The cost of interrupted work: more speed and stress”. Die empirischen Daten beweisen, dass es nach einer Unterbrechung durchschnittlich 23 Minuten und 15 Sekunden dauert, um zur ursprünglichen Aufgabe zurückzukehren. Lies die Studie hier.

- WIP-Limits und die Kanban-Methode: Um zu beweisen, dass das Management Kapazitäten nicht selbst regulieren kann und harte mathematische Einschränkungen benötigt, zitiere David J. Andersons grundlegendes Werk, Kanban: Successful Evolutionary Change for Your Technology Business (ISBN: 978-0984521401). Anderson leistete Pionierarbeit bei der Anwendung von Pull-Systemen und strikten Work-In-Progress-Limits in der Softwareentwicklung und prägte das operative Mantra “Stop starting, and start finishing”.

- Die 40-Prozent-Aufgabenwechsel-Strafe: Um die Illusion mathematisch zu zerstören, dass Entwickler mehrere “Priorität 1”-Tickets effizient jonglieren können, zitiere die Forschung von Joshua Rubinstein, David Meyer und Jeffrey Evans, die von der American Psychological Association (2001) veröffentlicht wurde. Sie bewiesen, dass die exekutiven Kontrollprozesse des Gehirns – Zielwechsel und Regelaktivierung – bis zu 40 Prozent der produktiven Zeit eines Mitarbeiters verbrennen, wenn ständig die Kontexte gewechselt werden. Lies die Studie hier.

- Aufmerksamkeitsrückstände (Attention Residue): Um zu erklären, warum ein blockiertes Ticket das Gehirn eines Entwicklers aktiv schädigt, selbst wenn er an etwas anderem arbeitet, zitiere Sophie Leroys grundlegendes Paper von 2009, “Why is it so hard to do my work?” (Organizational Behavior and Human Decision Processes). Sie bewies, dass Menschen Aufgaben nicht sauber “pausieren” können; ein kognitiver Rückstand bleibt an dem ungelösten Problem haften und beeinträchtigt die Leistung bei der nächsten Aufgabe massiv. Lies das Paper hier.

- Die Benchmarks der Flusseffizienz: Um zu beweisen, dass 100 Prozent Flusseffizienz ein mathematischer Mythos ist, zitiere das grundlegende Buch This Is Lean: Resolving the Efficiency Paradox (ISBN: 978-9198039306) der Forscher Niklas Modig und Pär Åhlström aus dem Jahr 2012, das den destruktiven Konflikt zwischen Ressourceneffizienz und Flusseffizienz ursprünglich definierte. Für die spezifischen Benchmarks der Softwareindustrie verweise auf die empirischen Daten, die erstmals von den Lean-Forschern Zsolt Fabók und Håkan Forss präsentiert wurden (Lean Agile Scotland, 2012). Ihre weithin akzeptierten Daten belegen, dass nicht optimierte Wissensarbeiter-Teams typischerweise mit einer Flusseffizienz von 2 bis 5 Prozent arbeiten, während 15 Prozent ein gesunder Durchschnitt sind und das Erreichen von 40 Prozent eine Organisation auf ein elitäres Weltklasseniveau hebt.